大学時代から人工知能(AI)や進化計算の研究を続けてきたという徳井直生さん。工学博士でありながらDJ、メディアアーティストという顔も持つ彼に、AIと自分、そして社会との関係についてお話を聞きました。

徳井 直生

株式会社Qosmo 代表取締役

東京大学工学系研究科電子工学専攻博士課程修了。工学博士。

2009年にQosmoを設立。AIと人の共創による創造性の拡張を模索する。

http://www.naotokui.net/

AIを活用して自分の発想の枠を超える

—AIや進化計算に興味を持ったきっかけは?

徳井:きっかけはいくつかありますが、最も大きかったのが、 大学3年生のときのカール・シムズの「ガラパゴス」というメディアアート作品との出会いです。12台のモニターが並べられ、それぞれに仮想生命体が表示されているんです。見ている人がそのうちの2つを選ぶと、その2つを掛け合わせた新しい仮想生命体が生まれる。最初はシンプルなんですが、進化を繰り返すことで次第に複雑なものが現れてくるんです。特に面白いと思ったのは、シムズの「自分でも、なぜこんな仮想生命体が生まれるのか説明できない」という言葉です。作者が予想できない動きをするのは、普通はバグですよね(笑)。とにかく新しいアイデアや創作物を生み出す仕組みとしての進化の仕組みやAIに興味を持ちました。

—音楽活動を開始したのもその頃ですか?

徳井:ええ。本格的に始めたのは大学時代からです。クラブなどに行きDJプレイをしたり、曲を作るようになったんです。とはいえ、楽器ができるわけでもなく理論も知らない。それでも自分なりの音楽表現をしたい!そこで進化やAIの仕組みを作って新しい音楽を生み出せないか、コンピュータを使って取り組んでいました。—AIでどのように音楽を作るのですか?

徳井:コンピュータは自分のイメージに形を与えるツール、もしくは何らかの作業を人間より早く実行するシステムといったイメージがあると思います。しかし僕がコンピュータやAIに求めるのは、自分の頭の外にあるバリエーションを生み出すことなんです。AIを利用して、自分の発想の枠を超えたいということですね。人間vsAIでBack to Back あり得ない選曲に「!」

—AI によるDJという取り組みもユニークですね。

徳井:「AI DJ PROJECT」と名付けていますが単にAIがDJをするのではなく、Back to Backという、人とAIが1曲ずつ曲をかけ合うというスタイルで行ってます。僕が1曲レコードをかけると、AIがそれを解析して次の曲を選ぶというわけですね。レコードプレーヤーの回転スピードなどを調整してのミックスもAIがやっています。—AI はどうやって選曲しているのでしょう?

徳井:選曲で重要なのは流れをキープすること。雰囲気が似ている曲をかけるのが基本です。AIの場合は、まず流れている曲を定量化します。音のスペクトルの画像をインプットし、ディープラーニングの技術を使いジャンルを推定するわけです。あとは楽器の識別や、ちょっとマニアックですがリズムマシンの識別もさせています。そういった解析から、曲の雰囲気の類似性を推定して、曲を選んでいます。

—AI による選曲はどうですか?

徳井:自分1人では得られなかった気付きというか、発想の広がりを感じることがありますね。例えば、こちらがテクノの曲をかけた後、AI がジャズを選曲してきたことがあったんです。これは合わないだろうと思ったんですが、実際にかけてみるとスゴくいい流れになりました。ただ、開発中ということもあって失敗することもあります。優秀なDJならできる、選曲にストーリー性を盛り込むといったことも、まだ難しいですね。

AIによるズレが生み出す「気付き」〜ブライアン・イーノのMusic Video〜

—最初に作ったソフトは覚えていますか?

徳井:学生のときに作った「SONASPHERE」ですね。仮想の3次元空間にいくつかのオブジェクトを並べて、その位置や関係に基づいて音を作るというものです。空間には重力や空気抵抗があり、カオス的な振る舞いが生まれます。制御できるものとできないものの中間、ある意味ズレのような部分からクリエイティブなものが生まれるんです。—制御できない動物を飼っているような感覚ですか?

徳井:植物の種を蒔いて育てる感覚かもしれません。品種はわかっていても、実際に育ててみるまで大きく育つかどうかわからない感じです。実は音楽を植物に例えるのは、音楽家のブライアン・イーノが言っていることです。コントロールと非コントロールの中間の感覚についても、同じことを話してますね。—なるほど。「The Ship」の話を伺いたいと思っていたところですが、以前から彼のファンなのですね。

徳井:そうです。そういった縁もあってか、彼の「The Ship」という楽曲のMVを作るプロジェクトに参加する機会を得たんです。Shipとはタイタニック号のことで、豪華客船に対する人々の過信と沈没という悲劇、そのあとに起こった人類初の世界大戦という、約100年前の世相を振り返るというのが曲のコンセプトです。同時にそういった状況は現在にも当てはまるのでは、という警鐘にもなっています。初期のアイデアは、AIに人間の歴史を回想させるというものです。具体的には、その日のニュース写真に類似する写真を歴史的な写真アーカイブから検索するというシンプルな仕組みがベースです。実際に試してみると、AIが、拷問されて四つん這いになっている兵士の写真から公園のベンチを類推するといったことが、よくありました。偶然なんですけど、ドキッとする組み合わせも多かったんです。

—どのような仕組みなんですか?

徳井:歴史的な写真をAIにたくさん取り込んでおき、まず特徴量を出しておきます。そこに新しいニュースの画像を与えて、特徴量が似ているものをピックアップするという仕組みです。工夫したのは、複数の画像認識のシステムを組み合わせることで、結果にズレが発生しやすいようにした点です。またコンテクストは無視するようにしています。間違いも含めて、AIが抽出した写真によって、人間がある種の気づきを得られる、少なくとも考えるきっかけを与える、そういった作品だと考えています。現実と虚構の区別を曖昧にするインスタレーション

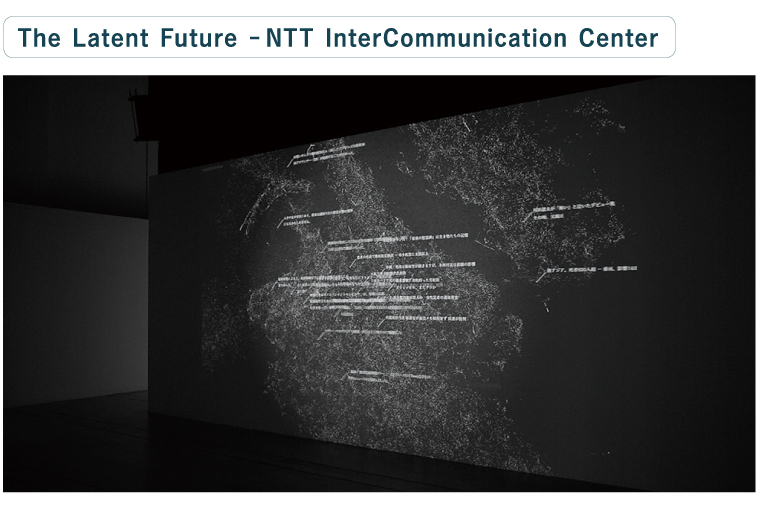

—NTTインターコミュニケーションセンター[ICC]の「The Latent Future─潜在する未来」の展示について教えてください。

徳井:「AIが夢想するオルタナティブな未来」というコンセプトの作品です。仕組みは違いますが「The Ship」とも関連しています。素材としてニュースを使うという点は共通なんですが、こちらは画像ではなくテキストです。まず過去20年ぶんぐらいの新聞のテキストデータを集めて解析し、機械翻訳のようなシステムを応用して特徴量を出します。そして、その数値を元にテキストによる3次元空間を作りました。近くにあるものほどテキストの特徴が近い、という空間ですね。そこに新しいニュースのテキストを入力すると、AIが同じように特徴量を抽出して3次元空間にマッピングし、近くのものと組み合わせてもう一度テキストに戻します。そこで新しいニュースのテキストが生まれるんです。